RAW vs JPEG vs Analog

Einleitung

In dem Artikel Analog vs Digial bin ich bereits kurz auf den wichtigsten Unterschied zwischen Analog und Digital eingegangen:

Bei Analogen Film gibt es theoretisch beliebige Zwischenstufen zwischen komplett dunkel und maximaler Belichtung.

Bei Digitalbildern wird der Analoge Wert (Anzahl der gefangene Photonen) in einen Digitalwert mit einer festen Auflösung (Zwischenschritten) umgewandelt.

Bei 12 Bit sind das 4096 Stufen.

Analog

Bei klassischer Analogbildentwicklung wurden die Abzüge des Films auch analog gemacht, die Farben blieben dadurch erhalten. Inzwischen wird nun aber der Film eingescannt und ausgdruckt. Da gehen die analogen Eigenschaften der Farbnuancen leider kaputt. Aber so ist halt Fortschritt manchmal.

Digital

Wie erwähnt, erhalten wir von der Optik und Elektronik nun eine Liste von digitalen Werten, die unseren Pixeln entsprechen.

Entscheidend ist nun, was mit den Roh-Daten passiert. Und da passiert eine ganze Menge.

Wer nun glaubt(e), dass RAW Bilder der Kamera diese Rohdaten sind, wird nun leider enttäuscht.

Das erste was die Kamera macht, sind diverse Korrekturfilter für den Sensor. Je nach Sensor und evtl. Kalibrierung, wird schon einiges am Bild korrigiert.

Um die evtl. verschiedenen Bit-Tiefen zu ignorieren, erkläre ich das mit Kommazahlen zwischen 0 (dunkel) und 1 (maximale Helligkeit)

In der Theorie sollte maximale Belichtung eine 1 ergeben, minimal eine 0, 30% eine 0,3, 70% eine 0,7. Leider sind die Sensoren nicht linear.

Sie haben Stärken, Schwächen und die Kurve sieht geschwungen aus. Leider sieht man diese Kurven nirgends.

Danach kommen je nach Kamera und Modell noch automatische Korrekturen für das angeschlossene Objekt. Wenn die Software in der Kamera erkennt:

Oh, Objektiv a und es ist bekannt dass das Objektiv z.B. am Rand dunkler wird, rechnet die Software automatisch das Bild heller.

Schon mal gewundert, warum für die "beste Erfahrung" eines neuen Objektiv ein Firmware update der Kamera empfohlen wurde? Das könnte der Grund sein.

Dazu kommen unzählige weitere Optimierungen, Rauschfilter, Referenz-Staubbilder und nachträgliches Schärfen und herstellerspezifische Farbkurven.

Hersteller A hat z.B. sattere Farben als Hersteller B, obwohl der gleiche Sensor zum Einsatz kommt.

Das ist übrigens bei Handy-Kameras noch viel viel stärker. Allerdings wird das dort manchmal als Feature verkauft. Bei "großen" Kameras sind das eher Bugfixes.

RAW

Was genau ist nun RAW? RAW ist das was nach den obigen Filtern rauskommt. Diese Filter kann man (soweit mir bekannt) nicht umgehen, außer durch Firmware-Hacks.

Dieses Bild kann nun aber mehr oder weniger gut komprimiert abgespeichert werden. Es enthält in der Regel die maximal Bittiefe und möglichst wenig Kompressionsartefakte oder idealerweise eine verlustfreie Kompression.

JPEG

Nachdem nun das RAW-Bild vorhanden ist, werden noch weitere Filter angewandt, z.B. der Weißabgleich, Effektfilter, etc. Danach wird das Bild von den Original 12 Bit auf 8 Bit Farbtiefe runtergerechnet und als JPEG mit einstellbarer Kompressionsqualität abgespeichert. Je höher die Qualität, desto größer das Bild aber auch weniger Artefakte.

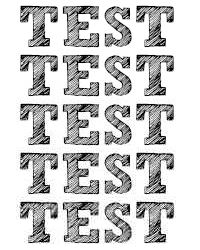

Hier ein Beispiel für die Artefakte.

Oberste Reihe ist das Original, darunter als JPEG mit 90%, dann 70%, 50% und final 30% Qualität. Am Ende in einem Bild zusammengefügt, vergrößert und verlustfrei abgespeichert.

In der Regel sind für "normale" Bilder die JPEG in der "Fine" Einstellung gut genug, solange die Bilder nicht mehr groß nachbearbeitet werden sollen. Entscheidend ist hier hauptsächlich die Reduzierung der Farbtiefe von 12 oder 14 Bit auf 8 Bit. Die Kompressionsartefakte sind meistens kaum sichtbar.